近日,我校网络空间安全学院以杭电为第一单位的学术论文MAT: Mixed-strategy Game of Adversarial Training in Fine-tuning被人工智能领域的顶级会议IJCAI 2023(International Joint Conference on Artificial Intelligence, CCF A类会议)录用。论文的第一作者是网络空间安全学院2022级硕士生钟哲华同学,指导老师王震教授为通讯作者,美国微软高级研究员陈天翼博士为共同作者。本届大会投稿量达4566篇,接受率约为15%。

近年来,迁移学习在自然语言处理(NLP)领域被广泛应用。传统微调方法训练后的模型很容易出现过拟合目标任务数据的问题。这会导致模型在未见数据上出现较差的泛化性能,从而影响模型的部署和使用。现有一些研究表明,将对抗训练引入微调阶段可以缓解过拟合问题,并显著提高模型在目标任务中的泛化能力。从博弈论的角度来看,目前在微调阶段使用的对抗训练方法可以解释为模型和对抗扰动之间进行的纯策略博弈,而纯策略博弈的策略空间是有限的。根据纳什定理,纯策略博弈为混合策略博弈的一个子集,而且纯策略博弈下代表博弈稳定状态的纳什均衡可能并不存在。因此,通过应用混合策略博弈的理论来解释和重新制定对抗训练,可以进一步提高预训练模型微调后的性能。

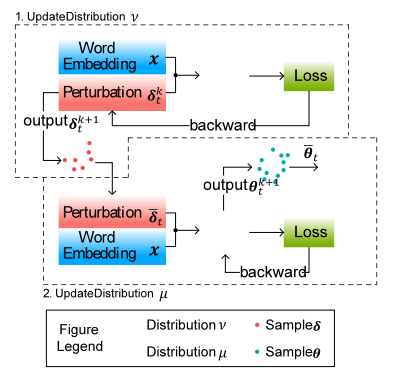

为了提高对抗训练收益的上限,本文提出采用博弈论中的混合策略对对抗训练算法进行优化。本文将对抗训练的参与方模型和对抗扰动视为博弈双方,并将对抗训练的纯策略博弈扩展为混合策略博弈。从而将博弈双方的策略空间从确定的取值转变为概率分布,以更好地应对对抗训练中的不确定性和复杂性。为了解决该博弈问题,本文利用熵镜像下降法得到了理论的纳什均衡。同时,为了使得算法更加实用化,本文采用了随机梯度郎之万动力学对分布进行采样,用采样得到的样本来近似分布,从而简化理论方法得到了可实际进行模型训练的混合策略对抗训练算法(Mixed-strategy Adversarial Training,MAT)。以下是论文中的示意图。本文通过大量实验验证了MAT算法的有效性,实验结果表明,该算法对微调模型的泛化性和鲁棒性均有显著提升效果。